Infraestrutura + Configurações de IA

A base de tudo: model de configuração, CRUD admin, provider de LLM, sistema de prompts e migrations. Deve ser mergeada primeiro.

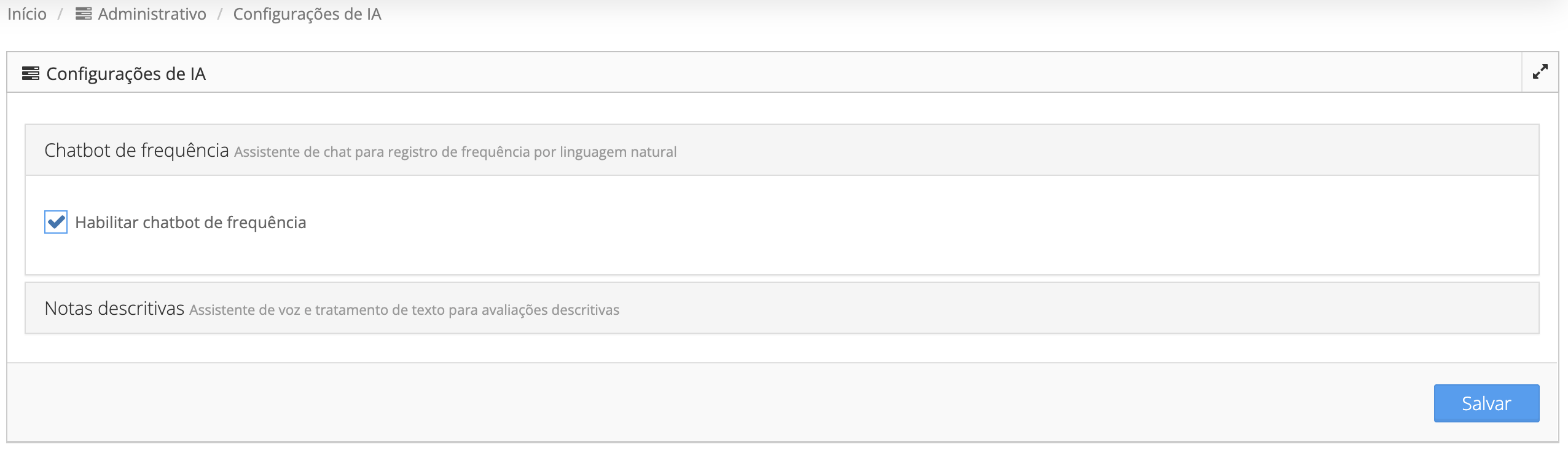

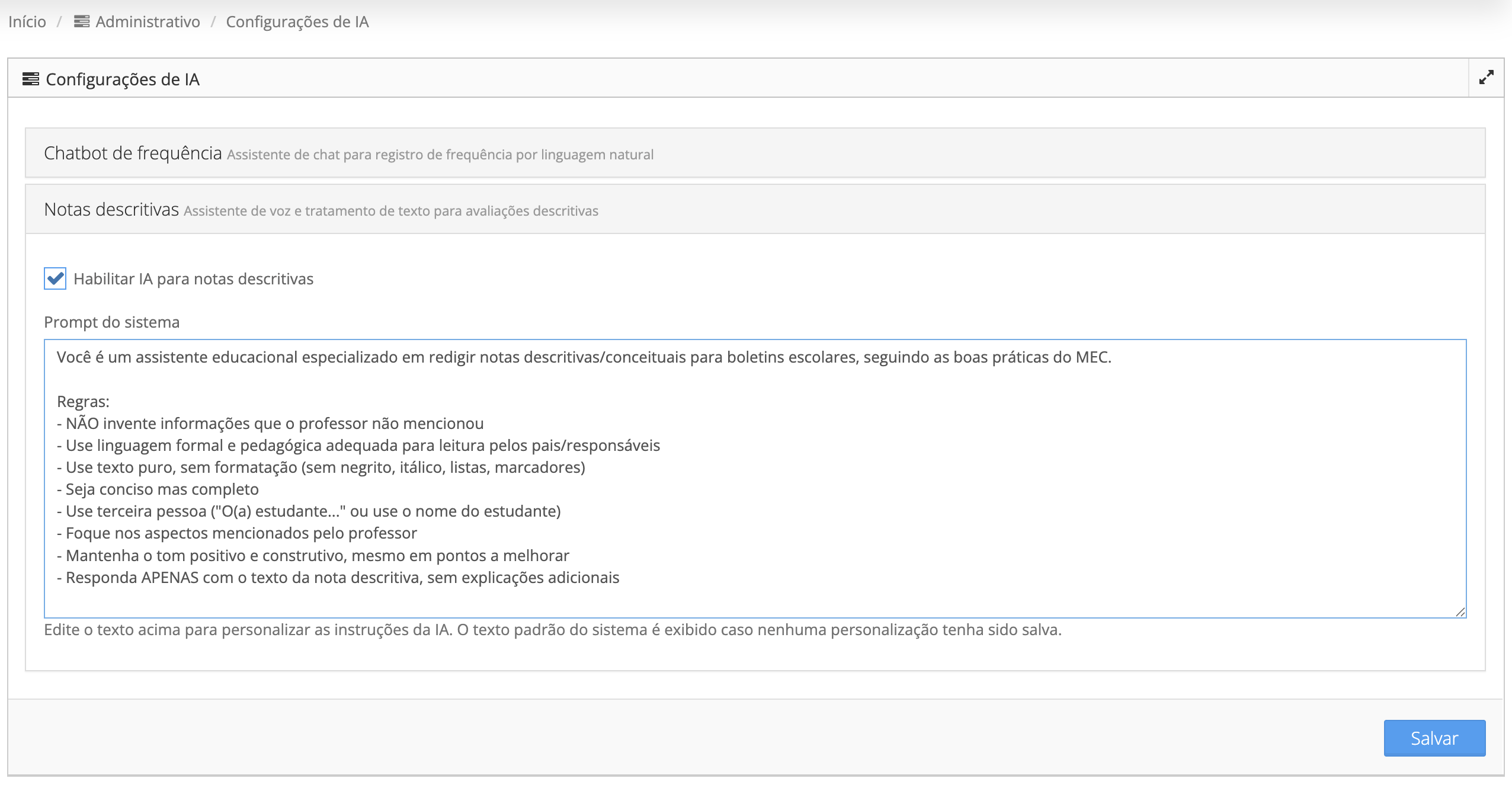

Painel de Configurações de IA

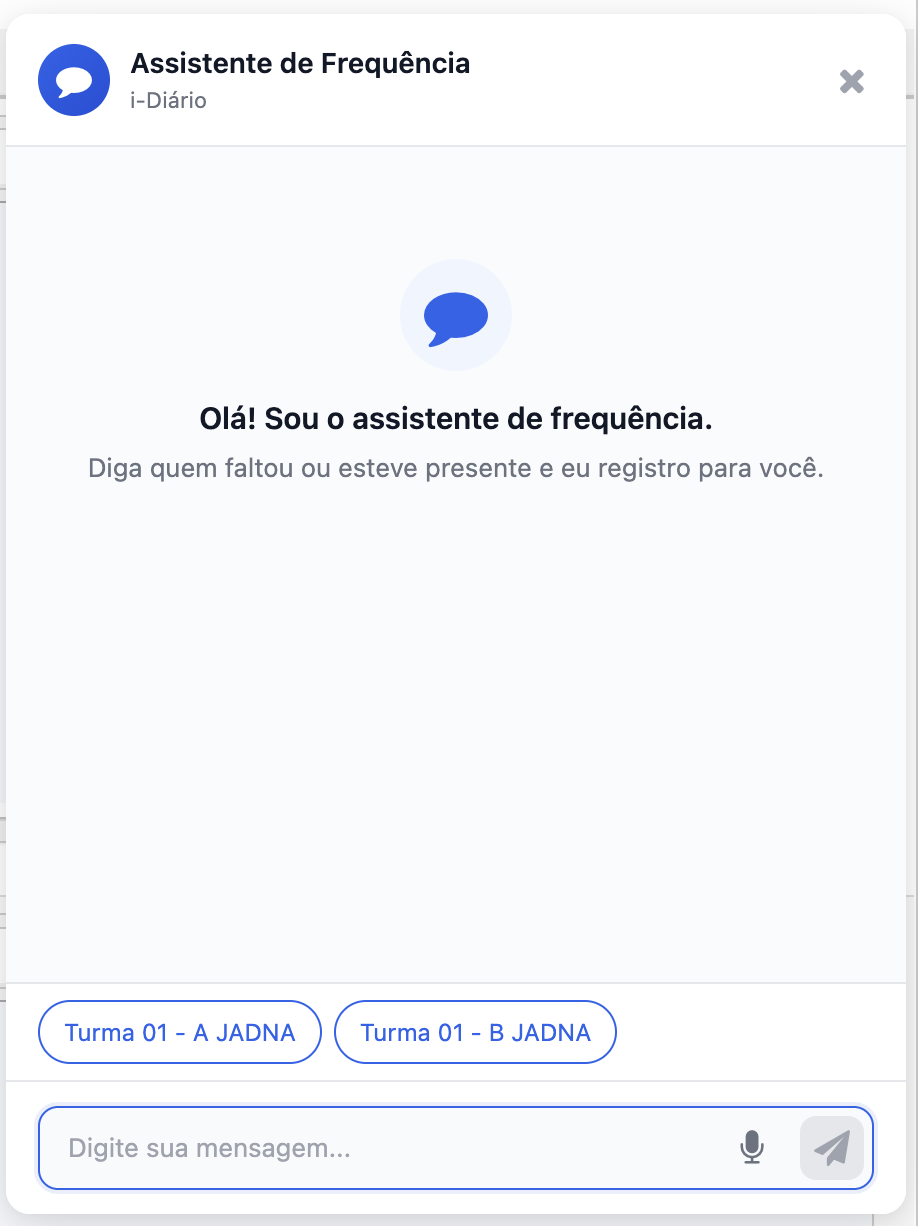

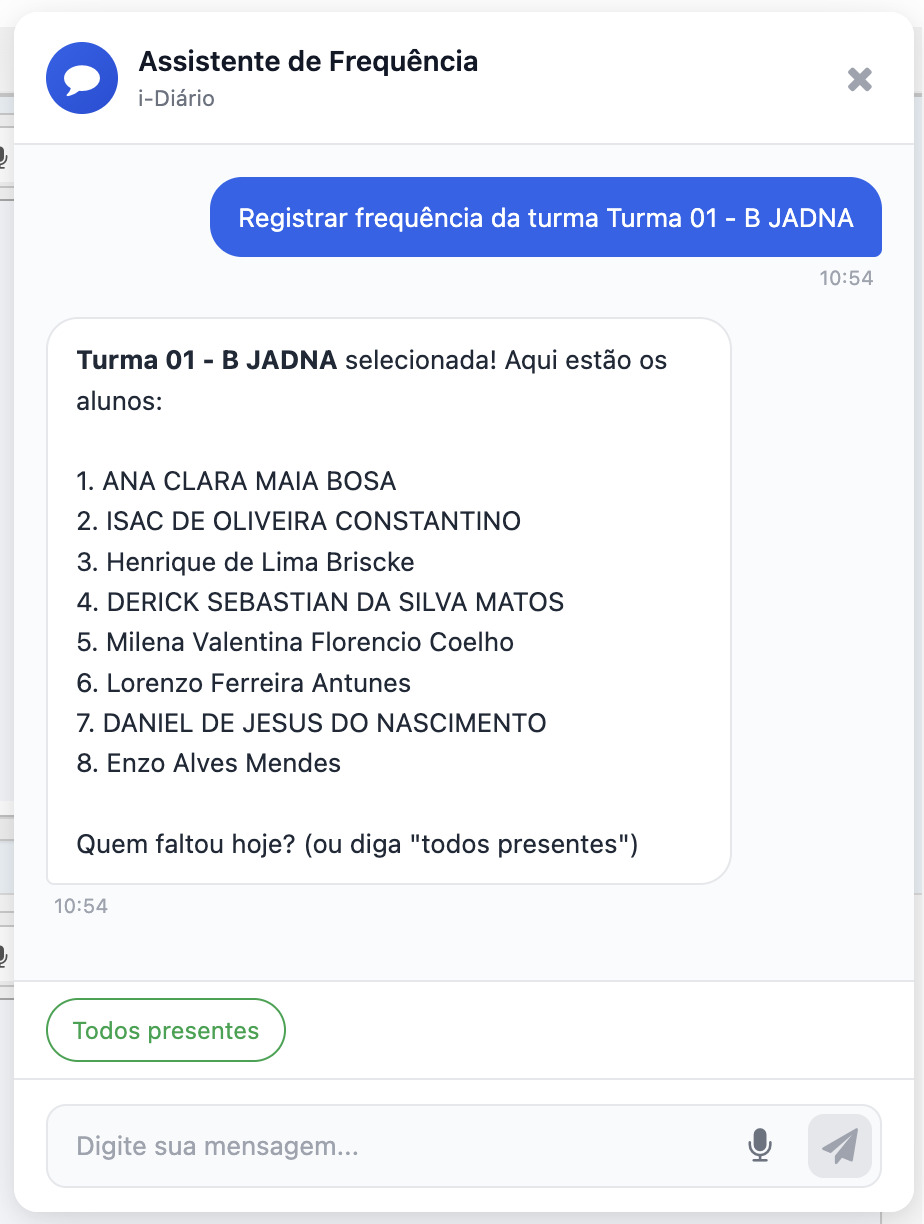

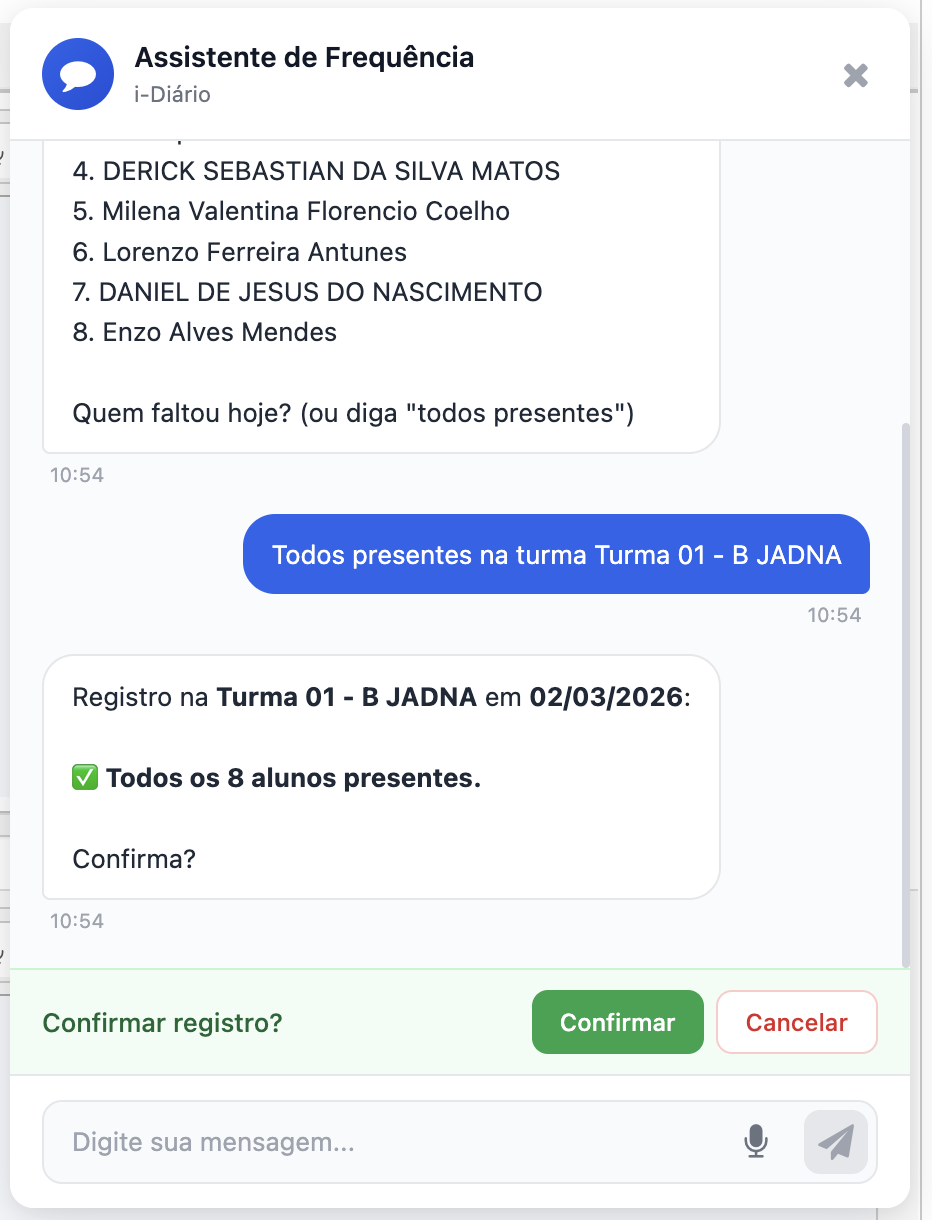

Acessível apenas para administradores, no menu Administrativo > Configurações de IA. Permite ligar/desligar cada feature de IA independentemente.

chat_enabled

Boolean (toggle)

Desativado

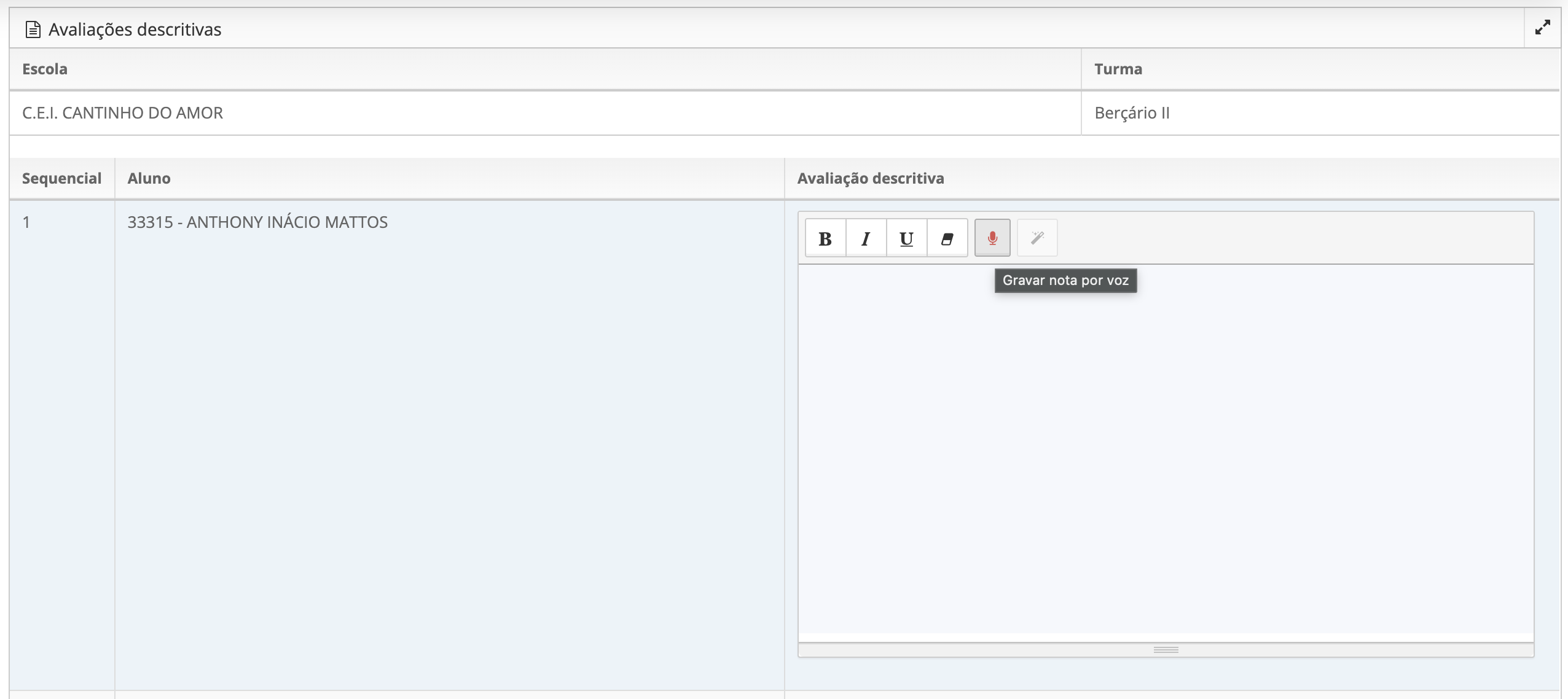

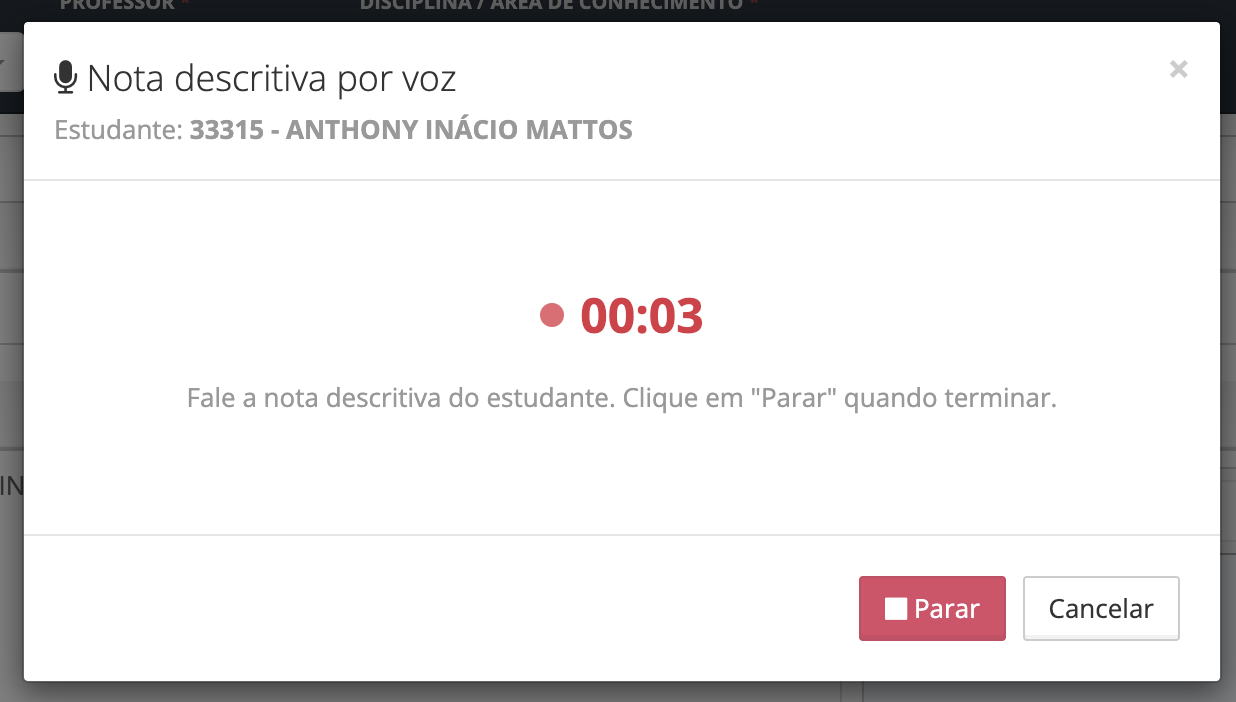

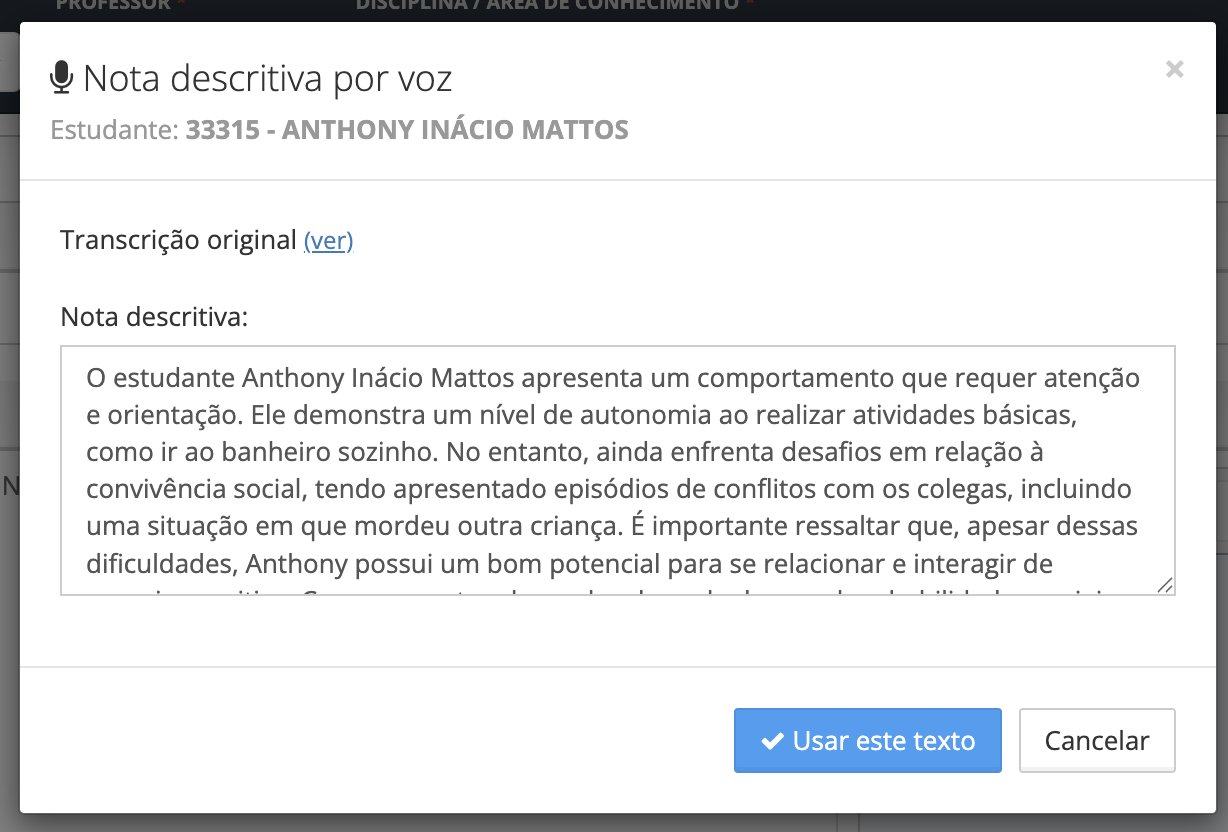

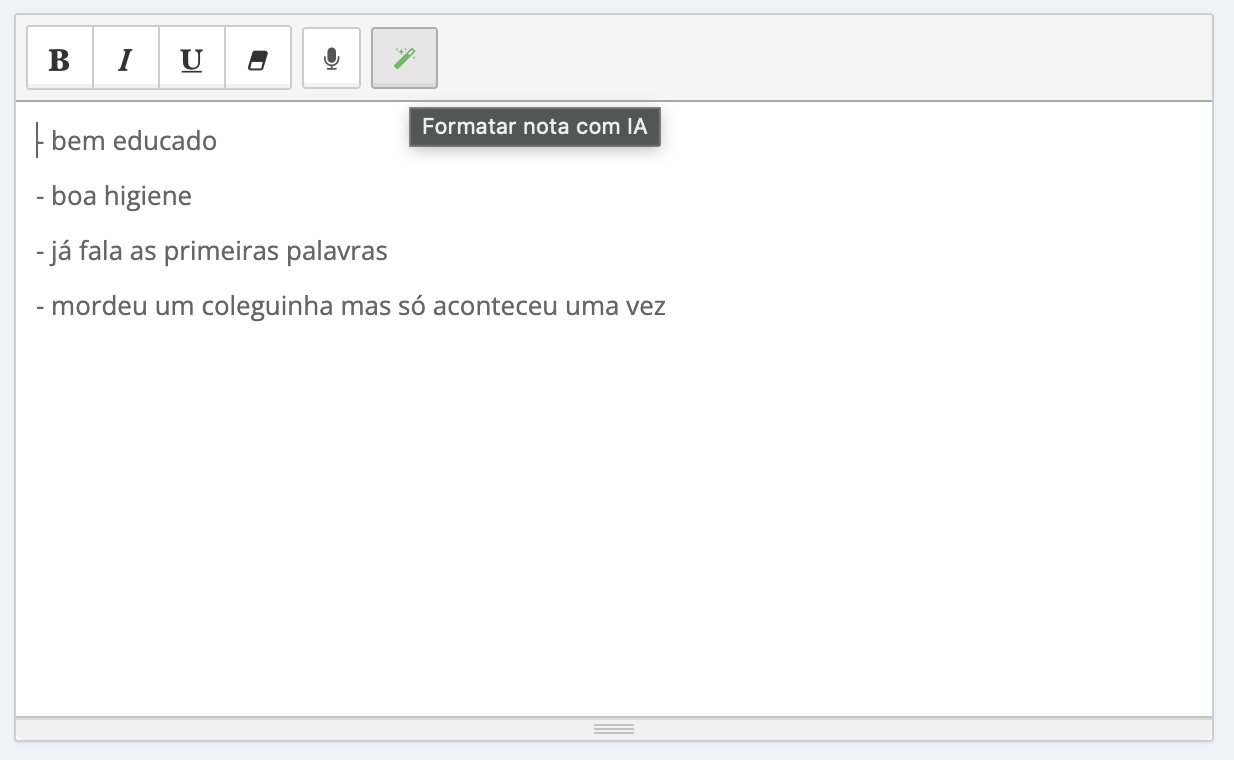

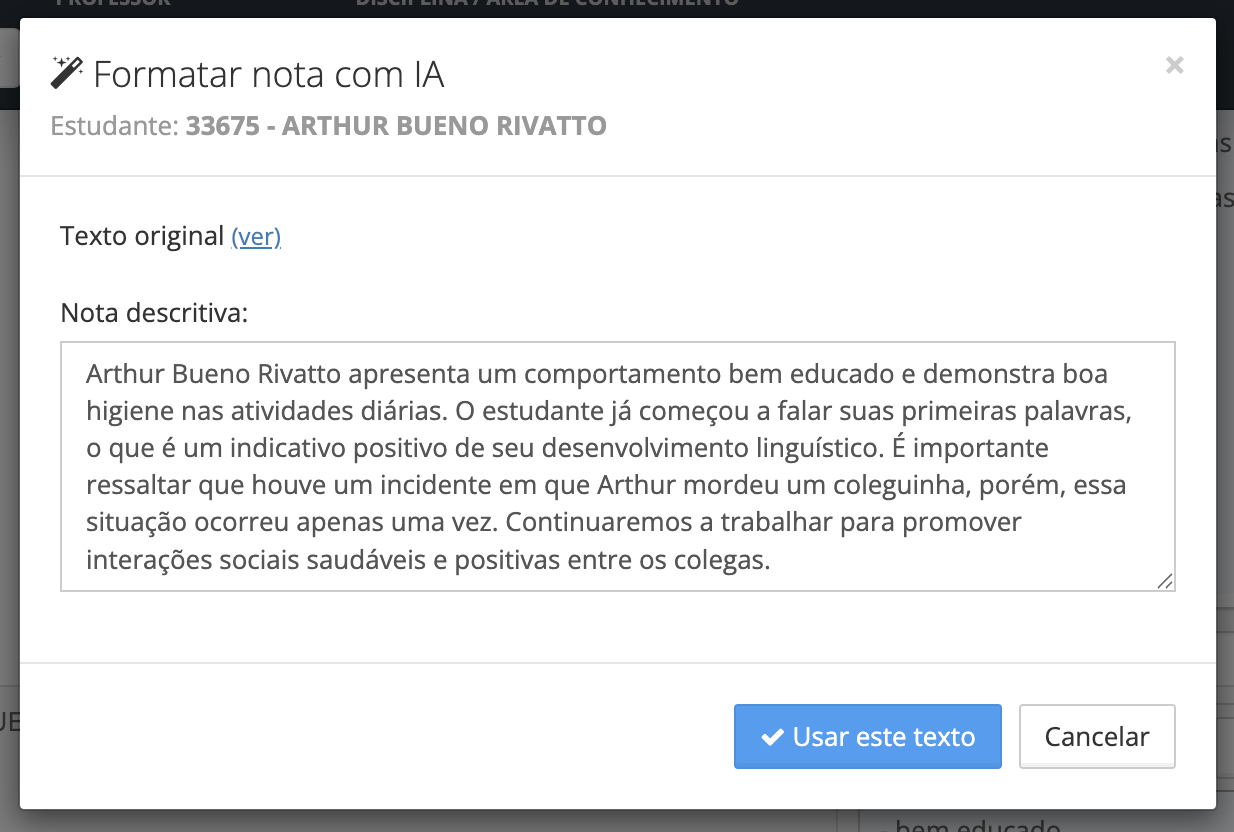

descriptive_ai_enabled

Boolean (toggle)

Desativado

descriptive_ai_prompt

Texto livre

Template padrão

Tudo é opt-in

As features de IA vêm desabilitadas por padrão. O administrador precisa explicitamente ativar cada uma. Sem chave de API do OpenAI configurada nos secrets, nada funciona.

Abstração de LLM Provider

O sistema usa um Factory Pattern para desacoplar a implementação do provider de LLM. Hoje usa OpenAI, mas a arquitetura permite adicionar Claude, Gemini ou outros facilmente.

Sistema de Prompts

Os prompts são templates ERB armazenados em app/prompts/, renderizados pelo PromptRenderer.

Isso separa o conteúdo do prompt da lógica de código.

Schema: ai_configurations

| Tabela | Campos Principais | Propósito |

|---|---|---|

ai_configurations |

chat_enabled, descriptive_ai_enabled, descriptive_ai_prompt |

Singleton com feature flags e prompts customizáveis |

Painel de Configurações de IA

Esta é a base — deve ser mergeada primeiro

22 arquivos · +623 linhas · As PRs #347 e #348 dependem desta